Matérias relacionadas

Inteligência Artificial

Parar a tecnologia? Não. Acelerar a regulação!

O medo da IA fora de controle não é novo. O que é novo é o medo de perder a corrida pela IA

Inteligência Artificial

A Inteligência Artificial e seus três eixos regulatórios

A ética dos dados, a ética dos algoritmos e a ética das práticas devem embasar as propostas de legislação que busquem provocar a internalização de conceitos de “certo” ou “errado”

Inteligência Artificial

A nomeação de um comitê de risco ético de IA é para ontem

Abordagens padrão ignoram dezenas de possíveis problemas éticos. Para melhor mitigar os riscos, as empresas precisam de recomendações de um grupo multidisciplinar, com autoridade para emiti-las

Inteligência Artificial

IA Responsável: um caminho a percorrer

Novas pesquisas mostram que, embora os líderes concordem que a IA responsável deve ser uma preocupação da alta administração, poucos priorizaram essas iniciativas. Por onde começar?

Inteligência Artificial

Europeus tornam o AI ACT mais rígido, próximo da aprovação

Texto da futura lei europeia passa a incluir regras para controlar a IA Generativa e o banimento de vários tipos de sistemas de identificação e categorização biométrica e de reconhecimento de emoções

Inteligência Artificial

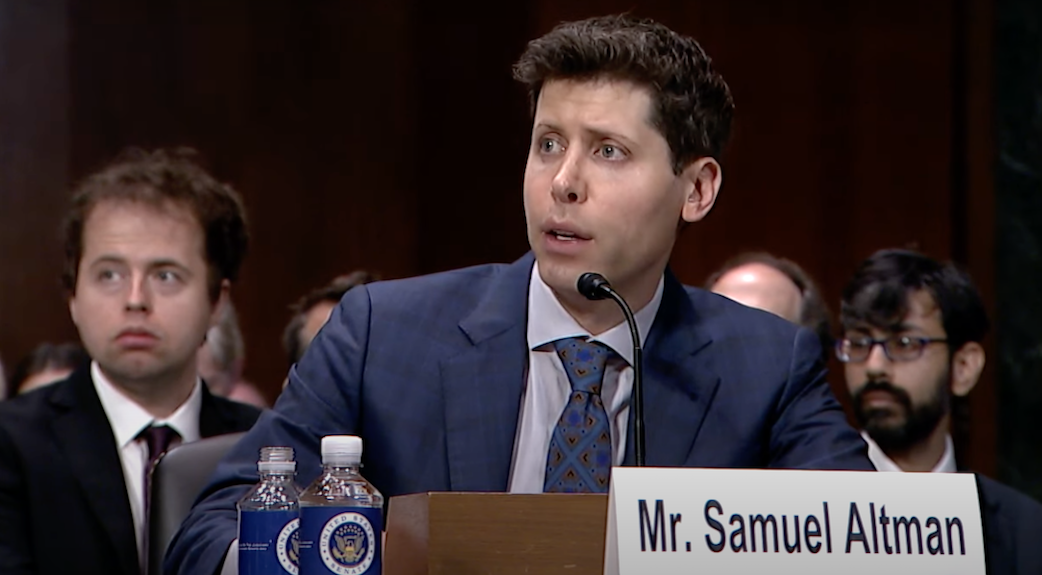

CEO da OpenAI vai a Washington

Sam Altman disse aos senadores americanos que é preciso criar regulamentos e licenças para sistemas de Inteligência Artificial