Matérias relacionadas

Inteligência Artificial

A subespecificação está arruinando o desempenho dos modelos de Mach...

O processo usado hoje para construir a maioria deles não pode dizer se funcionarão adequadamente no mundo real - e isso é um problema

Inteligência Artificial

Algum dia a IA será completamente imparcial?

Tecnicamente, sim. Um sistema de IA pode ser tão bom quanto a qualidade de seus dados e o design de seus modelos. Por isso é tão importante neutralizar os vieses cognitivos dos algoritmos

Inteligência Artificial

É hora de deixar a IA criar uma IA?

Um mundo em que a própria Inteligência Artificial (IA) é capaz de criar a si mesma? Esse mundo já chegou

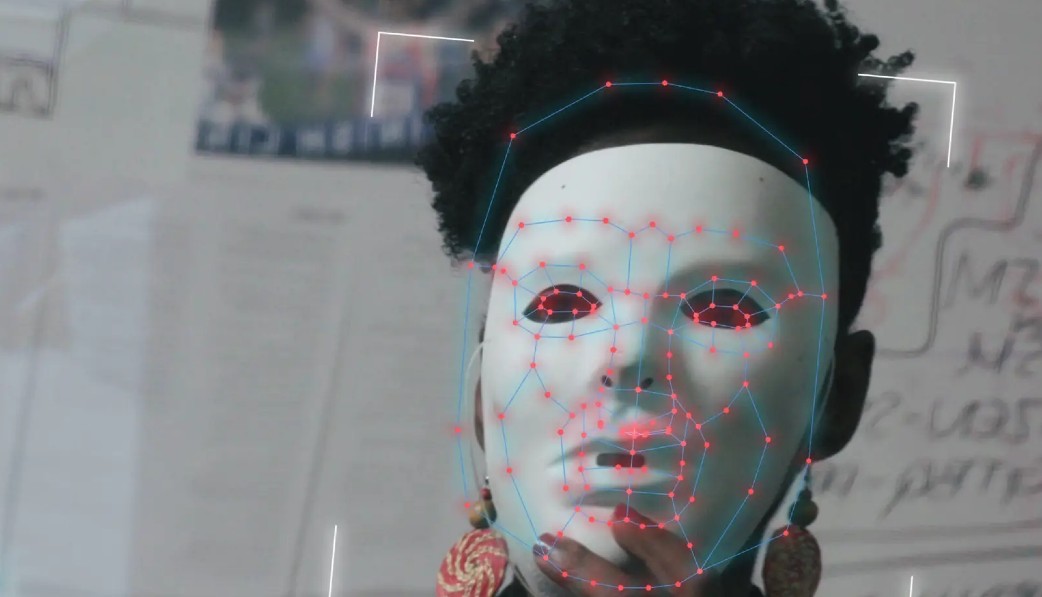

Inteligência Artificial

“Precisamos entender e controlar os algoritmos”

A cineasta Shalini Kantayya fala sobre o que aprendeu com a produção do documentário “Coded Bias”, que explora os efeitos do viés algorítmico e questiona se, em algum momento, a IA vai ficar mais esperta e nos trancar do lado de fo...

Inteligência Artificial

IA Explicável também precisa ser ética

Quanto mais deixamos a IA seguir por esse caminho pouco transparente, maior a probabilidade de chegarmos a lugares que não desejamos - e de onde talvez não tenhamos volta

Inteligência Artificial

Nem toda Inteligência Artificial requer milhões de dados

Muitos pesquisadores sustentam que, na maioria das vezes, a IA se torna ainda mais inteligente e poderosa se tiver a capacidade de ser treinada com Small Data