Matérias relacionadas

Inteligência Artificial

Princípios éticos da Inteligência Artificial

Os compromissos com a IA ética só têm valor se implementados. Compartilhar as melhores práticas se tornará cada vez mais importante

Tendências

Depois da governança de dados e IA, a privacidade

Especialistas em risco, conformidade e profissionais em geral têm sido cada vez mais forçados a lidar com as ramificações regulatórias e operacionais. Sua empresa sabe como fazer a coisa certa?

Inteligência Artificial

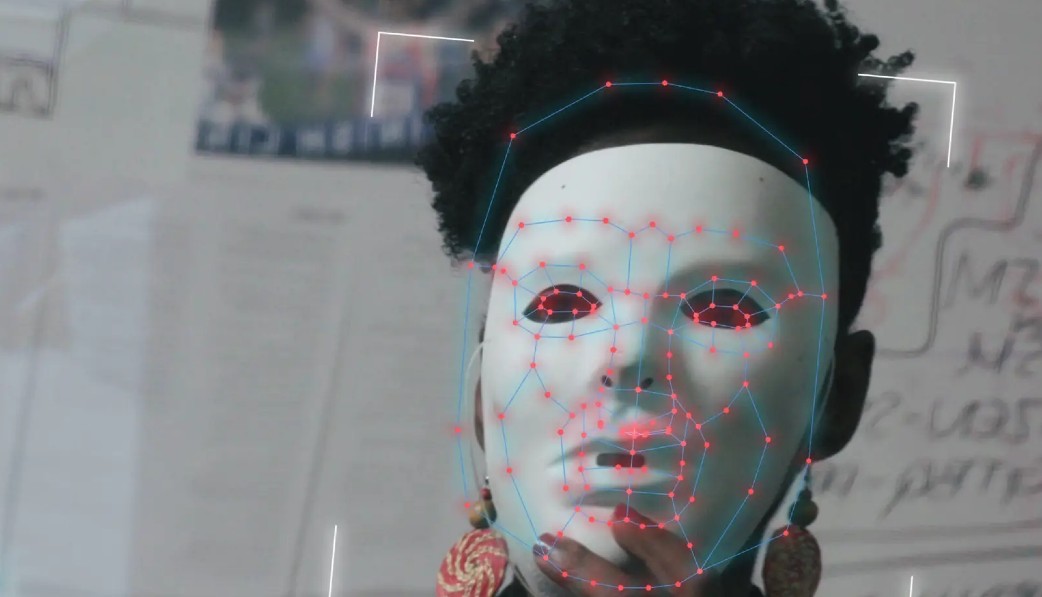

“Precisamos entender e controlar os algoritmos”

A cineasta Shalini Kantayya fala sobre o que aprendeu com a produção do documentário “Coded Bias”, que explora os efeitos do viés algorítmico e questiona se, em algum momento, a IA vai ficar mais esperta e nos trancar do lado de fo...

Inteligência Artificial

A Inteligência Artificial deveria ter empatia?

Há casos de uso em que a empatia pode ser útil em sistemas de IA? Ou ao aprender e introduzir sentimentos humanos, as máquinas podem acabar nos colocando em risco?

Inteligência Artificial

Chegou a hora de dar mais humanidade para a Inteligência Artificial

O que está em jogo? Tornar a tecnologia melhor para os negócios e para os humanos, apostando no trabalho de super equipes e no controle das ameaças decorrentes do viés algorítmico

Inteligência Artificial

Responsabilidade pela ética da IA é dos C-levels

À medida que a adoção da IA aumenta rapidamente, é fundamental que a ética da IA progrida de teorias abstratas para práticas concretas, sob a batuta dos executivos das áreas de negócios