O hype de IA está distorcendo o julgamento dos conselhos (e os CEOs estão preocupados)

Mais da metade dos CEOs ouvidos pelo BCG diz que seus conselhos confundem narrativa midiática com realidade operacional da IA; 60% acreditam que estão sendo pressionados a agir rápido demais

Os CEOs e membros de conselhos de administração parecem falar a mesma língua sobre a importância da Inteligência Artificial, a necessidade de adotar essa tecnologia com responsabilidade e quem deveria liderar essa transformação. Mas quando as respostas são cruzadas com mais cuidado, ou seja, quando se compara o que cada grupo diz sobre o outro, sobre si mesmo e sobre as pressões que sente, acaba o entendimento.

O relatório “Split Decisions: The BCG CEOs and Boards Survey”, publicado recentemente pelo Boston Consulting Group (BCG), identificou cinco divergências que variam de preocupantes a potencialmente paralisantes:

- O hype tecnológico distorcendo o julgamento nos conselhos

- A autoavaliação inflada de conselheiros que os CEOs enxergam de outra forma

- A ansiedade de não ficar para trás empurrando os conselhos a pedir mais velocidade do que os CEOs consideram prudente

- A concentração informal de poder nas mãos dos CEOs num tema que, em teoria, todos dizem que deveria ser liderado coletivamente

- Uma discrepância na percepção de quanto a IA pesa (ou deveria pesar) na avaliação de desempenho dos próprios executivos.

O levantamento foi conduzido em março de 2026 e é o primeiro a comparar simultaneamente a perspectiva dos executivos no topo da empresa e a dos seus conselhos sobre IA. Foram ouvidos 625 líderes de empresas com receita anual superior a US$ 100 milhões em todo o mundo, sendo 351 CEOs e 274 membros de conselhos. Três quartos representavam empresas privadas e 24%, companhias listadas em bolsa.

O título do relatório – “Split Decisions”, ou “Decisões Divididas” – não é metáfora. O que torna esse quadro especialmente relevante é o momento em que ele aparece. Tanto a IA Generativa quanto a IA Agêntica saíram da fase experimental e estão sendo implementadas em escala em muitas organizações. As decisões de governança tomadas (ou não tomadas) agora vão moldar por anos como essas empresas colherão os benefícios e enfrentarão os riscos dessa tecnologia. Nesse contexto, falhas de alinhamento entre a liderança e o conselho não são apenas um problema de dinâmica interna: podem ser fatais para a transformação.

1. O hype tecnológico como ruído – e como um problema de governança

A primeira fissura que o BCG identifica é, talvez, a mais sutil, mas não a menos relevante: CEOs acreditam que os conselhos estão sendo influenciados pelo hype midiático sobre IA de uma forma que distorce seu julgamento e complica o processo decisório. Mais da metade dos CEOs ouvidos disse que gostaria que seus conselhos fizessem algo diferente em relação à IA. A resposta mais comum foi alguma variação de “entender melhor a diferença entre o hype e a realidade”.

Os comentários escritos pelos próprios executivos no questionário são reveladores na sua franqueza. “Parar de assistir às notícias falsas de negócios na mídia sobre o que a IA pode fazer e quão rapidamente isso pode se tornar realidade”, escreveu um CEO. Outro pediu que o conselho “adotasse uma visão informada e realista, em vez de uma baseada em manchetes”. Um terceiro foi ainda mais direto: “Ser mais informado sobre o básico para ter opiniões equilibradas tanto sobre o lado positivo quanto sobre os potenciais riscos da adoção de IA.”

Do outro lado, os membros de conselhos têm suas próprias frustrações. Eles gostariam que os CEOs fossem mais proativos na comunicação sobre sua visão de IA, mais abertos a explorar o potencial transformacional da tecnologia e mais claros ao apresentar os casos de negócios que justificam os investimentos. “Trazer para o conselho mais insights sobre os casos de uso de IA na nossa organização”, pediu um conselheiro. Outro esperava que o CEO “usasse mais imaginação para o futuro e estivesse pronto para mudar completamente o modelo de negócio”.

Esse cruzamento de expectativas não satisfeitas é um sinal de disfunção na comunicação sobre IA no nível de governança corporativa. A pesquisa do BCG aponta que muitos conselhos têm sido bombardeados com narrativas amplificadas pela mídia e por fornecedores de tecnologia sobre substituição de empregos em massa, a chegada iminente da Superinteligência (AGI), a corrida entre empresas que adotam IA agora e as que serão deixadas para trás. Sem ter, necessariamente, o contato suficiente com casos reais de implantação, com os gargalos operacionais e com as curvas de aprendizado que os CEOs enfrentam no dia a dia.

O resultado é um descompasso perigoso: os CEOs com mais contato com a realidade da implementação precisam governar com conselhos cujas expectativas foram moldadas por uma narrativa externa que frequentemente superestima a velocidade e subestima a complexidade. Isso não é apenas um problema de comunicação interna, é um risco estratégico, porque decisões sobre ritmo de investimento, prioridades tecnológicas e tolerância ao risco são tomadas nesse espaço de interpretação.

2. A autoconfiança dos conselheiros e o ceticismo dos CEOs

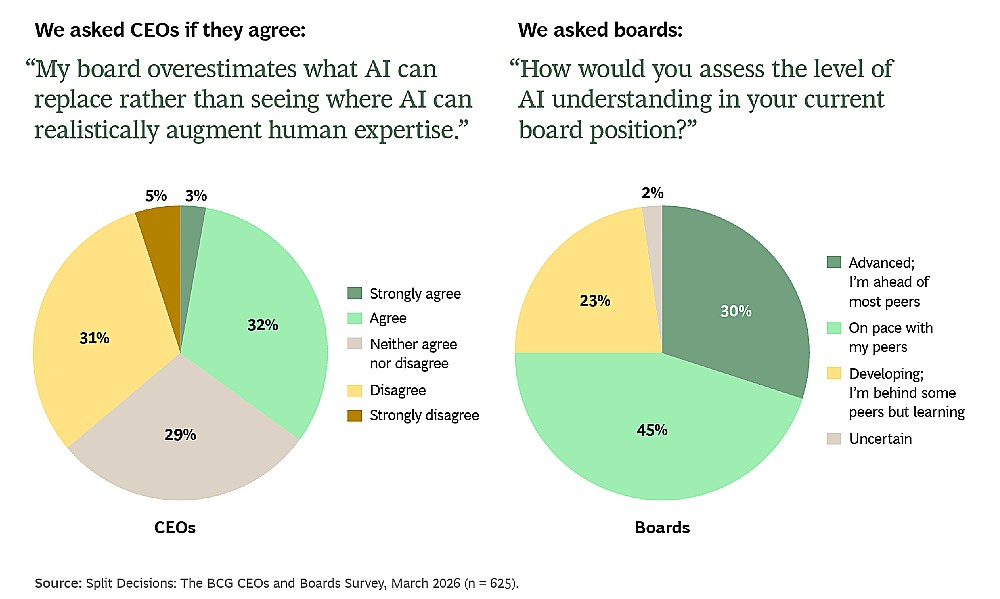

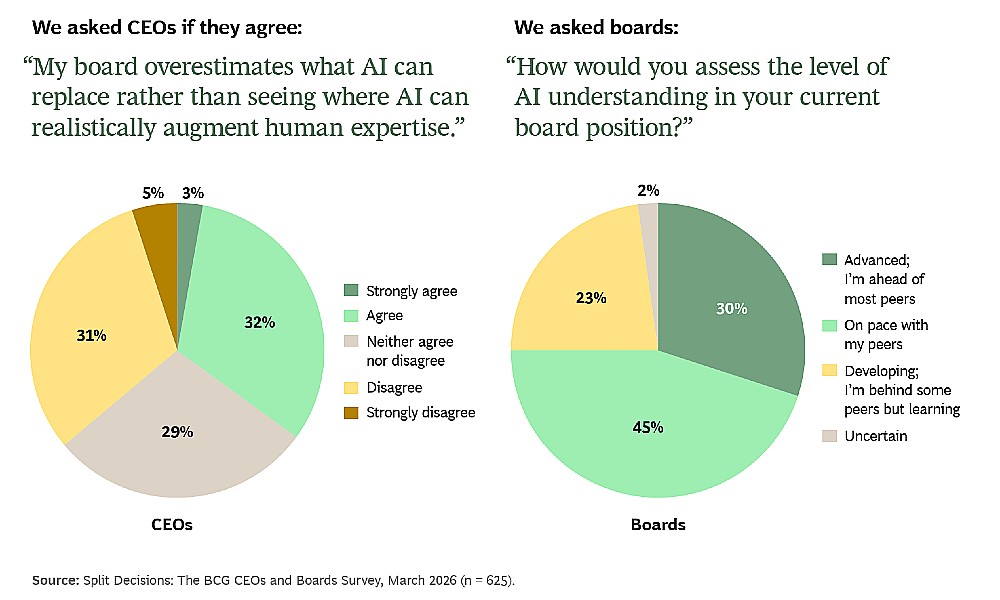

A segunda divergência de governança é ainda mais direta. Durante a pesquisa, os membros de conselhos foram questionados sobre como avaliam seu próprio nível de conhecimento sobre IA. A resposta foi confortante para quem está do lado do board: 75% dos conselheiros disseram que seu entendimento de IA está no mesmo nível ou é mais avançado do que o de seus pares. Apenas uma minoria reconheceu estar “em desenvolvimento” ou “incerta”.

Já os CEOs veem as coisas de forma diferente. Pelo menos 32% concordam e uma parte menor concorda fortemente que seus conselhos superestimam o que a IA pode substituir, em vez de enxergar onde ela pode realisticamente amplificar a expertise humana. Quase 40% dos CEOs afirmaram que seus boards não têm uma visão informada de como a IA está remodelando a estratégia de crescimento.

Trata-se de um problema clássico de metacognição, a capacidade de avaliar com precisão o próprio nível de conhecimento. Na área de IA especificamente, esse problema é amplificado por vários fatores. A linguagem da IA Generativa e da IA Agêntica é acessível: ferramentas como ChatGPT, Gemini e Co-pilot são fáceis de usar, criam uma experiência de competência que pode não se traduzir em compreensão dos limites, riscos e complexidades de implantação em ambientes corporativos. Um conselheiro que usa essas ferramentas no dia a dia pode genuinamente acreditar que entende IA – e estar certo num sentido superficial, mas errado no que importa para uma decisão de governança.

Para os CEOs, essa lacuna entre a autoavaliação dos conselheiros e a realidade que eles observam cria um desafio duplo. De um lado, precisam gerir expectativas excessivamente otimistas de conselhos que superestimam o que a IA pode entregar e com que rapidez. De outro, precisam educar sem serem condescendentes, ou seja, mostrar as limitações da tecnologia sem parecer que estão sendo excessivamente conservadores ou pouco ambiciosos, o que, como veremos adiante, é uma acusação feita por alguns conselheiros.

Os comentários escritos no relatório capturam essa tensão. Um CEO pediu que o conselho “se tornasse letrado rapidamente e mantivesse um interesse ativo nessa área, o que permitiria que os membros fizessem perguntas melhores e me desafiassem de forma mais construtiva também”. Outro solicitou que o conselho “buscasse oportunidades para aproveitar a IA para melhorar a eficiência da organização”, sugerindo que o problema, nesse caso, é menos excesso de entusiasmo e mais falta de engajamento prático.

A questão do letramento em IA (AI literacy) como competência de governança não é nova, mas está se tornando urgente. O Fórum Econômico Mundial (WEF) e a National Association of Corporate Directors (NACD) nos EUA publicam com alguma frequência orientações sobre como conselhos podem desenvolver uma supervisão efetiva de riscos e estratégias de IA. O próprio BCG, em relatórios anteriores, argumentou que a ausência de letramento em IA nos conselhos é um dos principais fatores de risco para a governança corporativa nesta década.

3. O FOMO dos conselhos e a pressão por velocidade

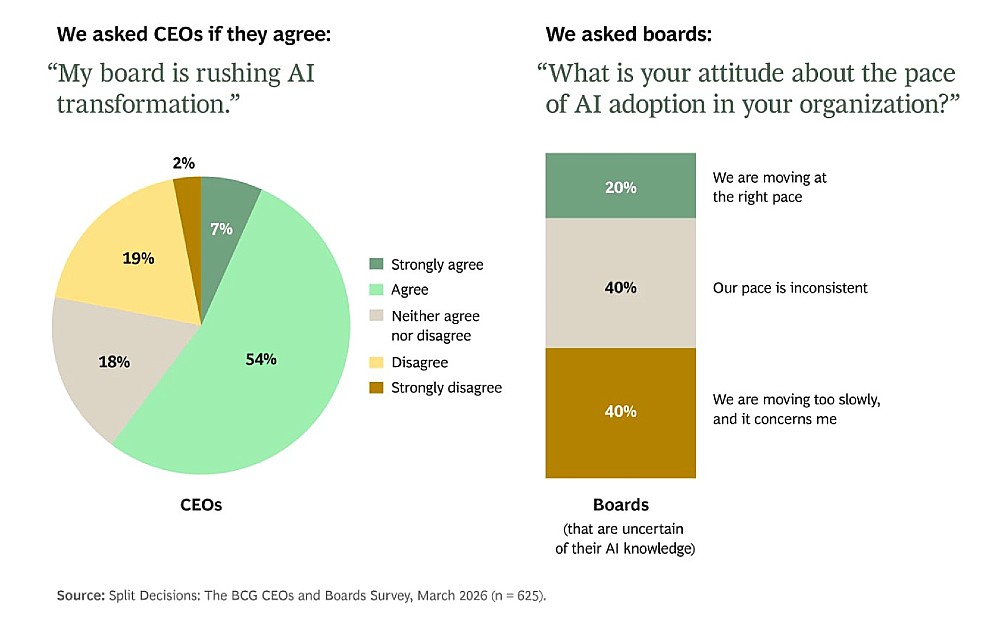

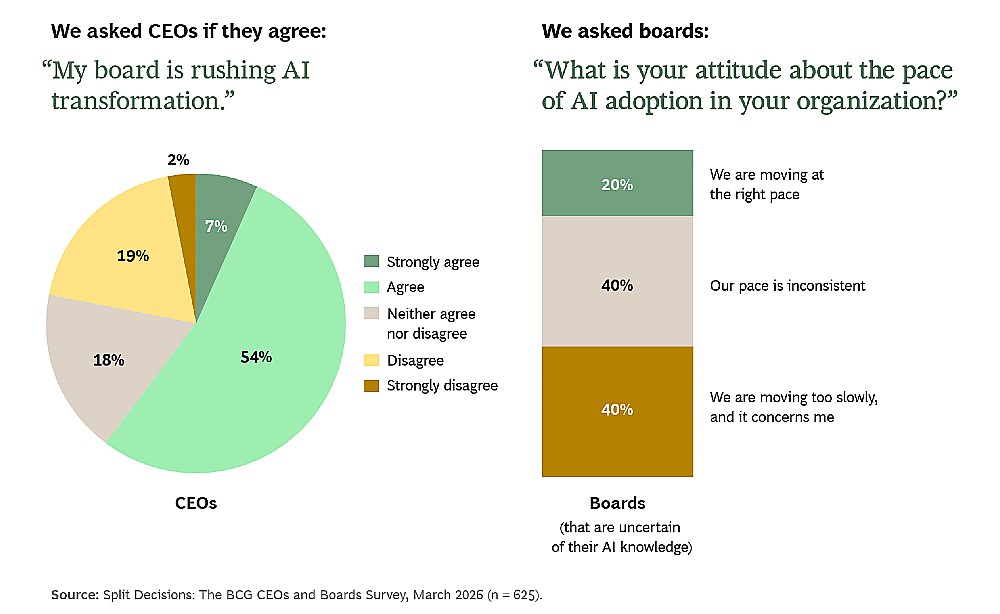

A terceira divergência é talvez a mais operacionalmente perigosa: a maioria dos CEOs acredita que seus conselhos estão pressionando por uma velocidade de adoção de IA que eles consideram precipitada. Os dados sugerem que parte dessa pressa vem exatamente de quem entende menos sobre a tecnologia. Aproximadamente 60% dos CEOs disseram que seus boards estão apressando a transformação por IA. Quando se olha para o lado dos conselhos, os dados confirmam a preocupação: 40% dos conselheiros acreditam que suas organizações estão se movendo devagar demais, e isso os preocupa. Outros 40% disseram que o ritmo é inconsistente. Apenas 20% avaliaram que a organização está avançando no ritmo certo.

O elemento mais revelador da pesquisa, no entanto, é o que o BCG chama de “Board FOMO”: o medo dos conselhos de ficar para trás. Os dados mostram que conselheiros com menor confiança no próprio conhecimento sobre IA são, em média, mais propensos a acreditar que a organização está avançando devagar demais. Em outras palavras: quanto menos um conselheiro entende de IA, mais ele tende a sentir que a empresa não está fazendo o suficiente, provavelmente porque, sem o contexto necessário para avaliar a qualidade e a profundidade dos projetos em andamento, a única dimensão disponível para julgamento é a visibilidade: o número de anúncios, a frequência das menções nos relatórios, a comparação com o que outras empresas estão declarando publicamente.

Esse mecanismo é bem documentado em outras esferas da tomada de decisão corporativa. A percepção de que concorrentes estão avançando mais rapidamente tende a criar urgência, independentemente de haver evidências concretas disso. Na IA, esse efeito é amplificado pela cobertura midiática intensa e pelos anúncios frequentes de empresas de tecnologia, que têm um interesse direto em criar a percepção de que quem não age agora ficará irreversivelmente atrás.

O problema é que pressão por velocidade sem letramento adequado tende a gerar dois tipos de resultados igualmente ruins. O primeiro é a adoção superficial: projetos lançados rapidamente para mostrar progresso, sem a infraestrutura de dados, os processos de governança e o treinamento organizacional necessários para que produzam valor real. O segundo é a aversão ao risco pós-fracasso: quando um projeto mal preparado não entrega os resultados esperados, a reação que poderia ser “precisamos fazer de forma mais madura” acaba virando “a IA não funciona para nós”, o que paralisa a transformação por anos.

Os comentários dos CEOs no relatório refletem essa preocupação com clareza. Um pediu que o conselho “fosse mais cauteloso e deliberado”. Outro alertou contra “decisões precipitadas ou pressão que incentiva a equipe a tomar decisões precipitadas”. Do lado dos boards, a tensão aparece na direção oposta: “Pressionar a organização para ser mais agressiva na busca de oportunidades.”

Aqui há um ponto de atenção adicional que o relatório do BCG não explora diretamente, mas que é relevante contextualizar: a pressão por velocidade muitas vezes não se traduz em alocação de recursos adequados para a transformação. Pedir rapidez sem prover a estrutura organizacional, o orçamento de treinamento e a capacidade técnica necessários é uma receita para projetos que existem no papel ou nos slides das reuniões de conselho, mas não na realidade operacional da empresa.

4. Quem lidera a IA na prática e o peso que recai sobre os CEOs

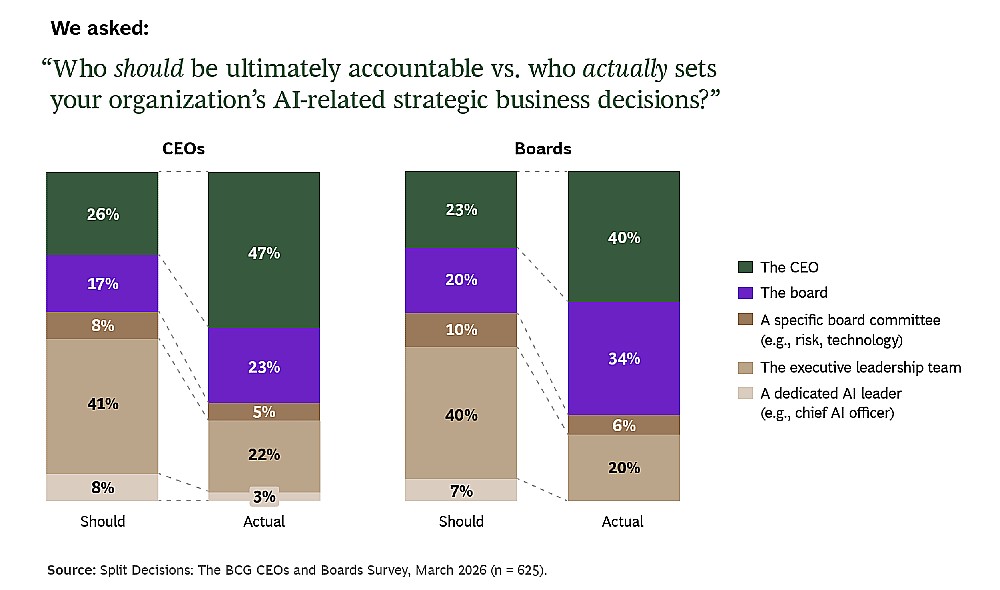

A quarta divergência encontrada pelo BCG diz respeito à governança de fato da estratégia de IA. Em teoria, há consenso: a maioria de CEOs e conselheiros concorda que a responsabilidade pela estratégia de IA deveria pertencer à equipe de liderança executiva, e não ficar concentrada no CEO ou numa única função tecnológica. Menos de 10% dos dois grupos acredita que um Chief AI Officer (CAIO) deveria ser o responsável final, o que reforça a visão de que a IA precisa ser incorporada a todas as funções do C-suite, do Chief Marketing Officer (CMO) ao Chief Product Officer (CPO), do Chief Financial Officer (CFO) ao Chief People Officer.

Na prática, no entanto, o que acontece é diferente. Quando perguntados sobre quem de fato conduz as decisões estratégicas de IA em suas organizações, 47% dos CEOs disseram que são eles próprios. Quando chegou a vez de perguntar aos membros de boards, 39% indicaram o CEO como responsável real pela implementação.

O gap entre o que deveria acontecer e o que acontece de fato é um padrão comum em transformações corporativas. Quando se trata de IA, essa centralização informal no CEO tem como consequência mais imediata a sobrecarga: um CEO que acumula a responsabilidade pela estratégia de IA enquanto gerencia todas as outras dimensões da operação está, na prática, criando um gargalo. Decisões importantes ficam represadas enquanto aguardam a disponibilidade do executivo máximo, e a velocidade de aprendizado organizacional fica limitada pela capacidade individual de uma pessoa.

A segunda consequência é a fragilidade institucional. Quando a estratégia de IA vive principalmente na cabeça do CEO (e não está distribuída de forma plena pela liderança executiva), a saída do executivo se torna um risco estratégico de primeira ordem. As empresas que construíram essa dependência terão dificuldade de manter a consistência da transformação quando houver mudança na cadeira.

A terceira consequência é mais sutil: a concentração da liderança de IA no CEO pode sinalizar para o restante da organização que a IA não é, na prática, uma agenda de toda a empresa, mas uma prioridade pessoal da liderança máxima. Isso diminui o engajamento das outras lideranças e reduz as chances de que a transformação se ramifique naturalmente pelos departamentos.

O relatório não aborda diretamente uma questão que merece destaque: a inadequação das estruturas formais de comitês de conselho para lidar com a velocidade de evolução da IA. Na maioria das grandes empresas, a supervisão de tecnologia e risco digital é atribuída a um comitê específico, frequentemente chamado de Technology Committee ou Risk Committee. Mas esses comitês, mesmo quando bem compostos, têm uma cadência de reuniões que não acompanha o ritmo de mudanças na IA. Isso cria uma lacuna entre a velocidade com que a tecnologia evolui e a velocidade com que a governança corporativa consegue processar e responder a essas mudanças.

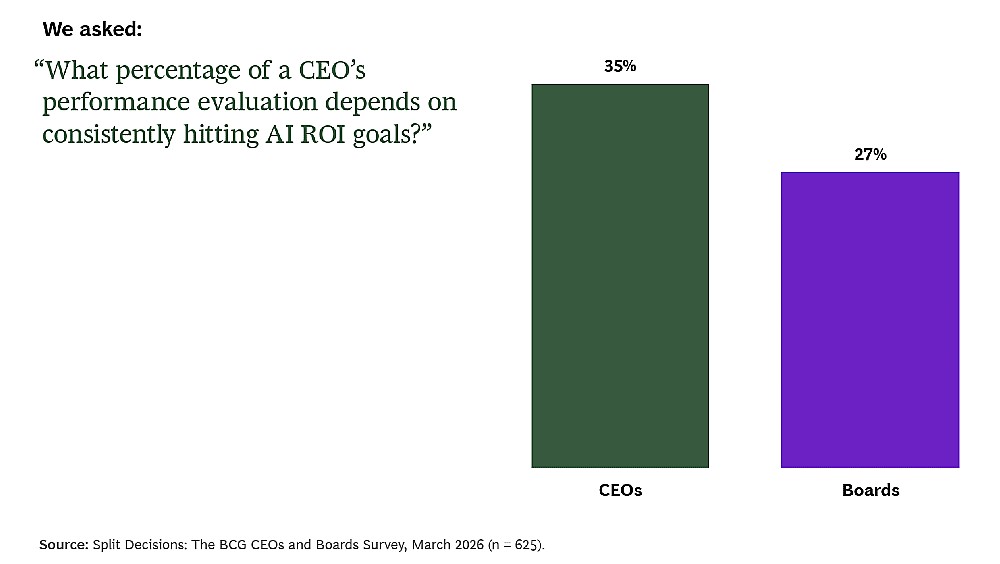

5. A avaliação de desempenho e o gap de accountability

A quinta divergência é, em certo sentido, a mais concreta: há uma discrepância considerável na percepção de quanto a IA pesa (ou deveria pesar) na avaliação de desempenho dos CEOs. Quando perguntados sobre qual percentual da avaliação de um CEO deveria depender do cumprimento de metas de ROI em IA, os próprios CEOs responderam, em média, 35%. Os membros de conselhos, por sua vez, indicaram apenas 27%. Essa diferença de 8 pontos percentuais pode parecer pequena em termos absolutos, mas é expressiva quando se considera o que ela revela sobre as expectativas cruzadas entre os dois grupos.

Os CEOs estão sentindo uma pressão maior do que os conselhos julgam estar exercendo. Eles percebem que mais de um terço de sua avaliação está vinculada ao desempenho de IA, o que cria uma lógica de priorização de projetos que, muitas vezes, privilegia a visibilidade e o retorno de curto prazo sobre a construção de capacidades de longo prazo. Ao mesmo tempo, os conselhos aparentemente não formalizaram essa expectativa com a mesma intensidade que os CEOs estão sentindo.

Esse gap entre pressão percebida e accountability formal tem implicações sérias. Do lado dos CEOs, a pressão não formalizada pode gerar comportamentos defensivos: o lançamento de projetos de IA cuja função principal é ser comunicado ao conselho, mesmo que o impacto operacional seja limitado. Do lado dos conselhos, a ausência de métricas claras de desempenho em IA significa que a avaliação do CEO nessa dimensão fica sujeita a critérios vagos, o que torna difícil distinguir o que é transformação real de transformação performática (o bom e velho “para inglês ver”).

Os comentários escritos pelos participantes capturam essa tensão. Um CEO pediu que o conselho “reconhecesse o tempo e o esforço necessários para a transformação”, sugerindo que a pressão por resultados rápidos não está sendo acompanhada por compreensão das dificuldades do processo. Um conselheiro, por sua vez, advertiu que o CEO não deveria “se deixar pressionar pela percepção de estar ficando para trás e tomar decisões precipitadas ou aplicar pressão que incentive a equipe a tomar decisões precipitadas”, uma orientação que é, ao mesmo tempo, um aviso sobre o risco do FOMO e, indiretamente, um reconhecimento de que o board pode estar contribuindo para essa pressão.

A questão de métricas para ROI de IA é um tema em construção em toda a indústria. Diferentemente de projetos de TI tradicionais, onde o retorno pode ser medido em eficiência operacional ou redução de custos em janelas de tempo relativamente curtas, projetos de IA frequentemente produzem valor de formas que desafiam a mensuração convencional: melhoria na qualidade de decisões, aceleração de ciclos de aprendizado organizacional, criação de capacidades que só se tornam vantagem competitiva no médio prazo. Estabelecer métricas de desempenho justas e rigorosas para IA é, por si só, uma tarefa complexa que exige letramento técnico e estratégico – e é exatamente esse letramento que, como demonstrou o relatório, frequentemente está ausente nos conselhos.

O letramento em IA como requisito de governança, não mais diferencial

Diante de todas essas divergências, não surpreende que o relatório do BCG identifique um ponto de raro consenso entre CEOs e conselheiros: a necessidade de que o letramento em IA se torne um critério formal para a composição dos conselhos de administração. A pesquisa mostra que 79% dos CEOs e 80% dos membros de boards acreditam que candidatos a conselheiros deveriam ser obrigados a demonstrar compreensão de como a IA pode transformar a indústria da organização, mesmo quando não estão sendo considerados por sua expertise tecnológica. Essa é uma das raras instâncias em que os dois grupos convergem com força quase idêntica.

Essa convergência representa uma mudança nas expectativas sobre o perfil dos conselhos. Uma mudança que, nos próximos anos, deverá se refletir nos critérios formais de seleção de conselheiros em todo o mundo.

Hoje, muitos processos de recrutamento para conselhos ainda tratam o letramento digital e o conhecimento de IA como “nice to have”, ou seja, um diferencial valorizado, mas não exigido. O que a pesquisa do BCG indica é que essa lógica está se tornando obsoleta rapidamente.

Os comentários dos participantes da pesquisa reforçam essa visão com propostas concretas. Um CEO sugeriu que o conselho “abrisse mão de um assento ou acrescentasse um com experiência em IA transformacional”. Um conselheiro defendeu que o CEO “buscasse suporte de assessores externos quando não houver competência adequada internamente”. Ambas as sugestões apontam para a mesma conclusão: a lacuna de letramento em IA nos conselhos é um problema real, que exige ação concreta, e que não se resolve apenas com a leitura de relatórios ou com a participação em briefings ocasionais.

Há aqui uma dimensão adicional que vale sublinhar. O letramento em IA que os conselhos precisam não é o mesmo letramento necessário para um engenheiro de Machine Learning ou mesmo para um executivo de produto. Conselhos não precisam saber construir modelos: precisam fazer as perguntas certas, avaliar os riscos de maneira informada, questionar a viabilidade dos planos estratégicos e proteger os stakeholders de decisões precipitadas ou mal embasadas. Esse tipo de letramento é específico para a função de governança e, por isso mesmo, não pode ser terceirizado integralmente para consultores ou para o próprio CEO.

As implicações práticas para a governança corporativa de IA

O relatório do Boston Consulting Group encerra sem prescrever soluções específicas. É, antes de tudo, um diagnóstico. Mas as cinco fraturas que ele documenta apontam para um conjunto de questões práticas que organizações em transformação por IA precisam enfrentar com urgência.

A primeira questão é a de como criar canais de comunicação entre CEOs e conselhos que vão além das reuniões formais e dos relatórios periódicos, e que permitam aos conselhos desenvolver uma compreensão mais profunda da realidade operacional da transformação por IA. Isso inclui os fracassos, os gargalos e os aprendizados que raramente aparecem nas apresentações preparadas para as reuniões de conselho.

A segunda questão é de como calibrar a velocidade de adoção. O relatório mostra que a pressão por velocidade, quando desacompanhada de letramento e de estruturas de governança adequadas, tende a produzir projetos de baixa qualidade que comprometem a confiança na IA no longo prazo. As organizações que estão crescendo mais rapidamente em maturidade de IA são, em geral, as que investiram em fundações sólidas – infraestrutura de dados, processos de governança, capacitação organizacional – antes de escalar os casos de uso.

A terceira questão é de como distribuir a liderança de IA de forma que ela não fique centralizada no CEO. Isso exige tanto mudanças estruturais, como a criação de fóruns de decisão sobre IA que incluam todo o C-suite, quanto mudanças culturais, que incentivem as lideranças de Marketing, RH, Operações e Finanças a assumir “ownership” sobre as iniciativas de IA em suas áreas, em vez de delegá-las a um grupo central.

A quarta questão é como medir o ROI de IA de forma que seja ao mesmo tempo rigorosa, justa e conectada com a realidade de como os projetos de IA criam valor. Isso exige que os CEOs e os conselhos trabalhem juntos para definir métricas antes de iniciar os projetos, e não depois que os resultados já apareceram ou falharam em aparecer.

Por último, a questão de como acelerar o letramento em IA dos conselheiros. Sessões de briefing ocasionais, visitas a centros de inovação e leituras recomendadas são pontos de partida, mas são insuficientes para construir a compreensão funcional que o papel de supervisão exige. É preciso ter programas estruturados de desenvolvimento de conselheiros, com foco específico em IA e seus impactos setoriais, e as organizações que investirem nisso cedo terão uma boa vantagem de governança sobre as que deixarem para resolver essa lacuna depois.

Governança de IA como vantagem competitiva

A pesquisa do BCG insere-se num contexto mais amplo de crescente atenção à qualidade da governança de IA nas organizações. Com a IA Generativa e a IA Agêntica se difundindo rapidamente (da automação de processos administrativos à tomada de decisões clínicas, financeiras e jurídicas), o gap entre empresas com estruturas de governança consistentes e as que estão improvisando tende a se tornar mais visível e mais custoso.

O risco regulatório é uma dimensão crescente dessa equação. A União Europeia, com seu AI Act, já criou um marco legal que impõe obrigações de governança, transparência e avaliação de riscos para sistemas de IA de alto impacto. Reguladores em outros mercados, incluindo o Brasil, com a tramitação do PL 2.338/2023, o projeto de lei que cria o marco regulatório da IA, estão construindo frameworks que aumentarão progressivamente as exigências sobre as organizações. Os boards que não entendem essas obrigações não conseguem exercer supervisão efetiva sobre o cumprimento delas.

O risco reputacional é igualmente relevante: incidentes com sistemas de IA (desde vieses em processos de contratação até falhas em sistemas de atendimento ao cliente, passando por casos mais graves de danos a consumidores) geram alta exposição para empresas de todos os setores. Em muitos desses casos, a investigação subsequente revelou que o conselho de administração não tinha visibilidade adequada sobre os sistemas de IA em operação na empresa.

Por fim, há o risco de oportunidade, o tal “Board FOMO”, mas de um tipo diferente do que a pesquisa documenta. O verdadeiro risco não é o de adotar IA devagar demais para agradar ao mercado financeiro ou às manchetes, mas o de não construir as capacidades organizacionais que permitirão capturar, no médio prazo, os ganhos reais de produtividade, inovação e vantagem competitiva que a IA pode proporcionar. E esse tipo de construção exige exatamente o que o relatório do BCG mostra estar faltando: uma liderança coordenada, informada e alinhada entre CEOs e conselhos. O tempo para construir esse alinhamento é agora, enquanto as decisões mais consequentes ainda estão sendo tomadas.