Atenção humana: o custo que agentes de IA não exibem na fatura

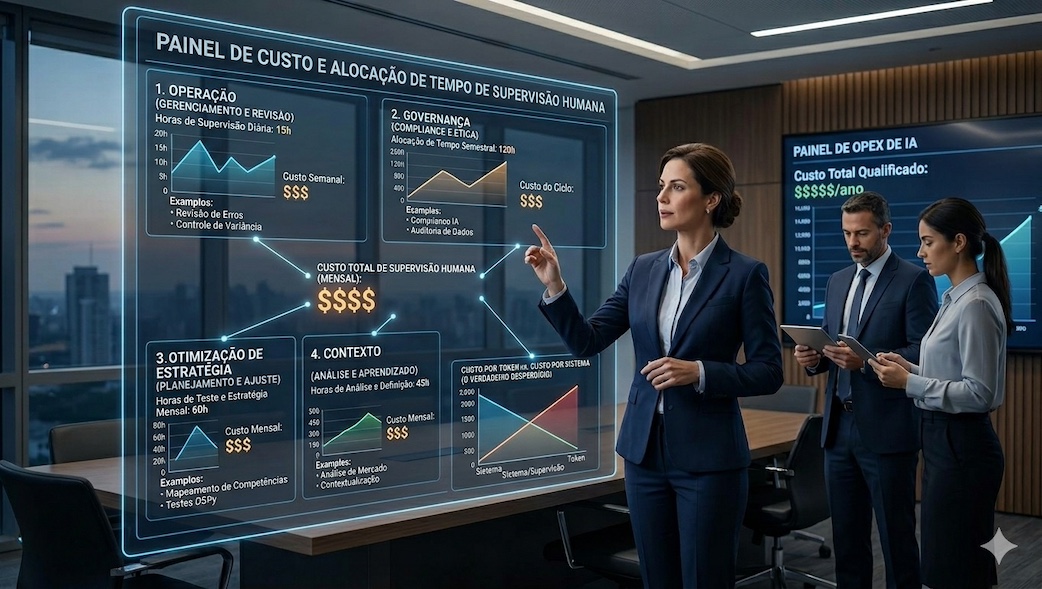

Supervisão humana mal alocada e workflows sem processo crescem com o uso agêntico; esse custo não aparece em nenhum relatório de infraestrutura.

A discussão sobre custo em IA está mal enquadrada. Organizações continuam tratando o problema como uma questão de preço de API: qual modelo usar, quanto custa por token, qual fornecedor é mais barato. Essa é a parte visível da equação; à medida que o uso agêntico escala, torna-se a menos determinante.

Mike Taylor, head de consultoria de tecnologia da publicação Every e coautor de Prompt Engineering for Generative AI (O’Reilly), propôs um enquadramento mais preciso: o recurso mais caro em qualquer workflow de IA é o tempo de quem o opera. O valor da atenção humana! Workflows inteiros roteados para modelos avançados, independentemente da complexidade da tarefa, são o sintoma mais visível do problema. O problema estrutural subjacente é a ausência de arquitetura. A supervisão humana mal alocada.

O resultado é um sistema em que o custo técnico parece controlado, mas o custo operacional cresce sem ser medido. Profissionais refazem contexto, corrigem inconsistências e tomam decisões que deveriam estar documentadas, não por limitação da tecnologia, mas porque o trabalho não foi estruturado para prescindir dessa supervisão. A fatura dos modelos captura uso. Não captura o desperdício de atenção qualificada.

O gargalo que o custo de token esconde

Tratar custo de API como proxy do custo real é um erro de enquadramento. A fatura é visível; o custo de oportunidade da atenção humana mal alocada, não.

Taylor usa uma analogia direta: nenhuma empresa escalaria seu CEO para operar a chapa de uma lanchonete. O custo horário tornaria o hambúrguer inviável. O mesmo raciocínio se aplica a qualquer profissional que usa um modelo de fronteira para tarefas triviais e, principalmente, a qualquer organização que mantém humanos no loop para garantir que essas tarefas funcionem de forma consistente.

A intuição de que modelos mais baratos resolvem o problema ignora um deslocamento concreto do gargalo. Como registrado em análise publicada pela The Shift em 22 de abril de 2026, o gasto corporativo total com IA cresceu 320% em 2025 mesmo com o custo por token caindo em ordem de magnitude. O mecanismo é direto: quanto mais barato fica usar IA, mais casos de uso se tornam viáveis; o volume cresce mais rápido do que a eficiência compensa. Modelos com raciocínio estendido acrescentam tokens internos de processamento à fatura sem que apareçam no output visível.

Workflows agênticos multiplicam chamadas de inferência de forma não linear.

Nesse cenário, a supervisão humana passa a operar como camada de contenção, absorvendo a variância que o processo não foi projetado para eliminar.

O custo técnico cai. O custo sistêmico cresce.

De uso de IA para arquitetura de trabalho

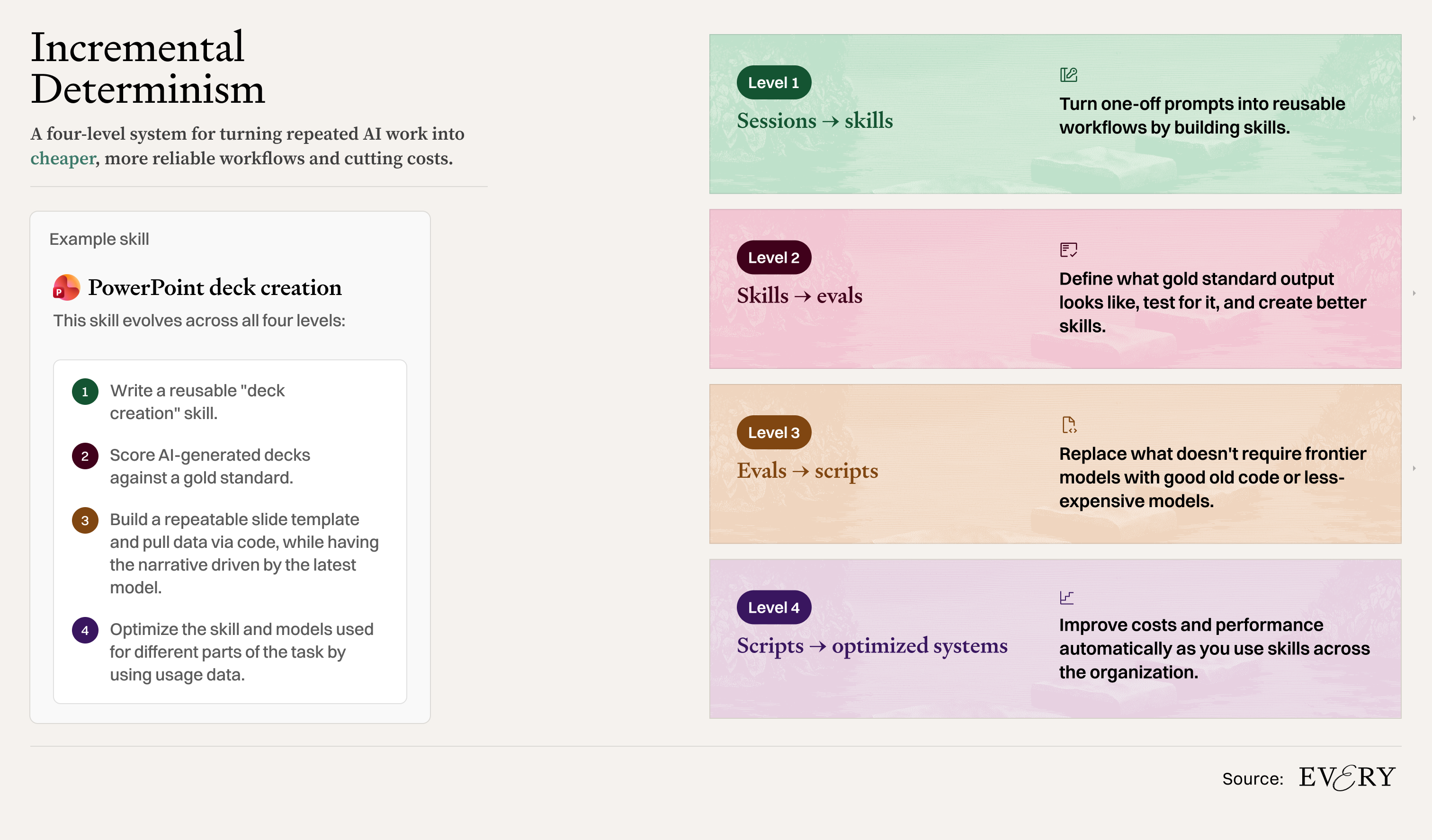

O que o framework de Taylor (incremental determinism) explicita vai além da otimização de tokens: é uma forma de reorganizar trabalho. A lógica é cumulativa. Toda tarefa repetida carrega um custo crescente de não sistematização; cada execução manual adiciona variação, retrabalho e dependência de contexto.

O método organiza essa transição em quatro níveis e expõe um problema: a maioria das organizações para antes de chegar onde o ganho real começa.

No primeiro, tarefas são documentadas como skills, arquivos de instrução reutilizáveis que permitem delegar execução a modelos mais baratos (Sonnet ou Haiku) sem supervisão contínua. Segundo Taylor, essa substituição reduz o custo da tarefa em 10 a 100 vezes.

No segundo nível, evals substituem revisão manual: métricas ponderadas permitem que o próprio modelo avalie seu output contra exemplos de referência (LLM-as-a-judge).

No terceiro, etapas que não exigem julgamento são convertidas em código determinístico, mais rápido, mais barato, sem LLM.

No quarto, a otimização dos scripts é automatizada via ferramentas como DSPy, que reescreve prompts para maximizar performance contra os evals definidos, frequentemente redirecionando execução para modelos menores.

Em todos os níveis, o deslocamento central é o mesmo: o profissional deixa de ser executor e passa a ser arquiteto do processo. O ponto crítico é a distinção entre onde o julgamento humano agrega valor e onde ele apenas compensa a ausência de processo. Sem essa distinção, a adoção de IA não elimina trabalho; multiplica-o sob a aparência de eficiência.

O que parece técnico é, em parte, comportamental

Há uma dimensão do problema que o framework não nomeia diretamente.

A maioria das organizações para antes de chegar onde o ganho real começa, geralmente no nível 1 ou 2. A explicação habitual é técnica: falta de fluência, ferramentas imaturas, integração complexa. Essa leitura é parcialmente correta, mas incompleta.

Jayshree Seth, cientista sênior e chief science advocate da 3M, nomeada ao Thinkers50 Radar em 2025, propõe um mapeamento comportamental útil para entender esse travamento. No framework GRANT (Grit, Resourcefulness, Adaptability, Navigation skills e Transcendence), Seth descreve as capacidades necessárias para operar em territórios sem mapa estabelecido. Aplicado à sistematização de workflows, o modelo indica que o gargalo frequentemente não é técnico, mas comportamental.

Persistência para estruturar o que ainda é fluido, capacidade de combinar recursos imperfeitos e disposição para recalibrar quando a ferramenta muda não são competências técnicas. São comportamentais. O que aparece como ineficiência operacional é, com frequência, incapacidade organizacional de sustentar esse tipo de comportamento sob incerteza. O gargalo não é só arquitetura; é também o que Seth chama de mentalidade de navegação: saber operar sem esperar que o terreno estabilize.

Os limites da eficiência

O argumento de otimização tem limites que o próprio framework apenas tangencia.

O primeiro é o risco de sistematização precoce. Processos determinísticos funcionam bem para tarefas estáveis. Em contextos ambíguos (estratégia, produto, pesquisa), estrutura excessiva pode reduzir adaptação, suprimir aprendizado e cristalizar decisões antes que o problema esteja bem definido. Há também um efeito de longo prazo menos visível: à medida que decisões são encapsuladas em skills, evals e scripts, o julgamento humano deixa de ser exercido naquelas etapas. No curto prazo, isso aumenta eficiência. No longo prazo, pode reduzir a capacidade crítica operacional da equipe. O risco de overfitting (sistemas que performam bem nas métricas e falham em situações novas) é a manifestação técnica desse problema; a supervisão humana é a principal defesa, mas só funciona se exercida por pessoas com repertório para identificar quando o sistema está errado.

O segundo limite está nos níveis mais avançados. A partir do nível 4, a decisão deixa de ser sobre como executar melhor uma tarefa e passa a ser sobre como gerenciar sistemas que se auto-otimizam. Isso introduz novas camadas de complexidade: manutenção de pipelines, validação contínua de métricas, controle de comportamento emergente. A economia de tokens é real; ela vem acompanhada de uma dívida de arquitetura que não aparece imediatamente, mas se acumula até se manifestar em falhas difíceis de diagnosticar. O método pressupõe fluência técnica crescente nos níveis 3 e 4 (seja interna ou contratada). O próprio Taylor reconhece que chegar a skills com evals já representa mais maturidade operacional do que a maioria das organizações atingiu.

O que observar a seguir

O teste de mercado mais próximo é a adoção do DSPy e ferramentas similares como infraestrutura padrão em operações corporativas, fora dos laboratórios. O trabalho de Andrej Karpathy com autoresearch, que executa mais de 20 experimentos de otimização automaticamente em uma única noite, indica que o ciclo de compressão já está em curso na camada técnica. Quando esse padrão migrar para operações de negócio em escala, a distância entre organizações com workflows sistematizados e as que continuam alocando atenção qualificada em tarefas repetíveis se tornará mensurável em OPEX e produtividade.

Há, porém, uma métrica anterior a essa que as organizações ainda não desenvolveram: custo por sistema, em contraste com custo por tarefa. Otimizar token a token é insuficiente quando o problema passa a ser o comportamento agregado de pipelines interdependentes. As organizações que chegarem primeiro a esse nível de visibilidade (sabendo não apenas quanto gastam com IA, mas onde a atenção qualificada está sendo consumida e por quê) terão uma vantagem operacional que não se resolve comprando acesso a modelos mais avançados.

O nível de maturidade em IA deixa de ser medido por acesso a modelos avançados quando a escassez migra do poder computacional para a capacidade de projetar sistemas em que atenção humana é usada apenas onde é insubstituível.