Matérias relacionadas

Inteligência Artificial

IA muda primeiro emprego; não como acreditávamos

Empresas com IA integrada estão contratando mais profissionais juniores, enquanto as tarefas que formavam esses profissionais estão desaparecendo ao mesmo tempo.

Inteligência Artificial

De plataforma de design a ponto de encontro de criatividade e produtiv...

Com 5.000 funcionários em uma semana dedicada à IA e US$ 4 bilhões em receita, a empresa redefine o que significa colocar o cliente no centro

Inteligência Artificial

A corrida pela IA mudou de lógica. A aposta agora é na IA que se rei...

O autoaperfeiçoamento recursivo avança dos laboratórios para a estratégia corporativa, com impacto sobre chips, infraestrutura e soberania computacional.

Inteligência Artificial

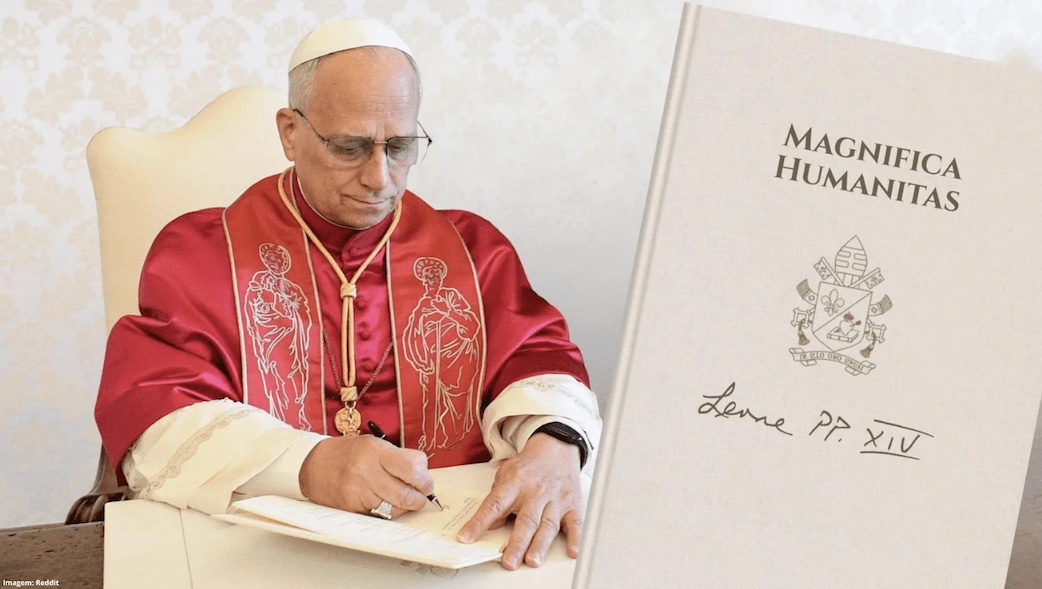

O Vale do Silício foi ao Vaticano. O Papa não cedeu.

Por meses, representantes de Meta, Google, Amazon e OpenAI trabalharam para moldar a primeira encíclica sobre IA. O texto publicado em 25 de maio ignorou o argumento central que levaram.

Inteligência Artificial

Cinco futuros possíveis: como a convergência tecnológica vai mudar...

De santuários analógicos a comunidades inteligentes autossustentáveis, um relatório da Universidade Monash — baseado em 93 estudos e entrevistas com 20 especialistas — mapeia as forças que vão definir onde habitamos, como envelhec...

Inteligência Artificial

Deepfake-as-a-Service ganha escala

Governos e empresas precisam criar estruturas de confiança digital diante da escalada de fraudes sintéticas, clonagem de identidade e campanhas automatizadas de desinformação.