Matérias relacionadas

Inteligência Artificial

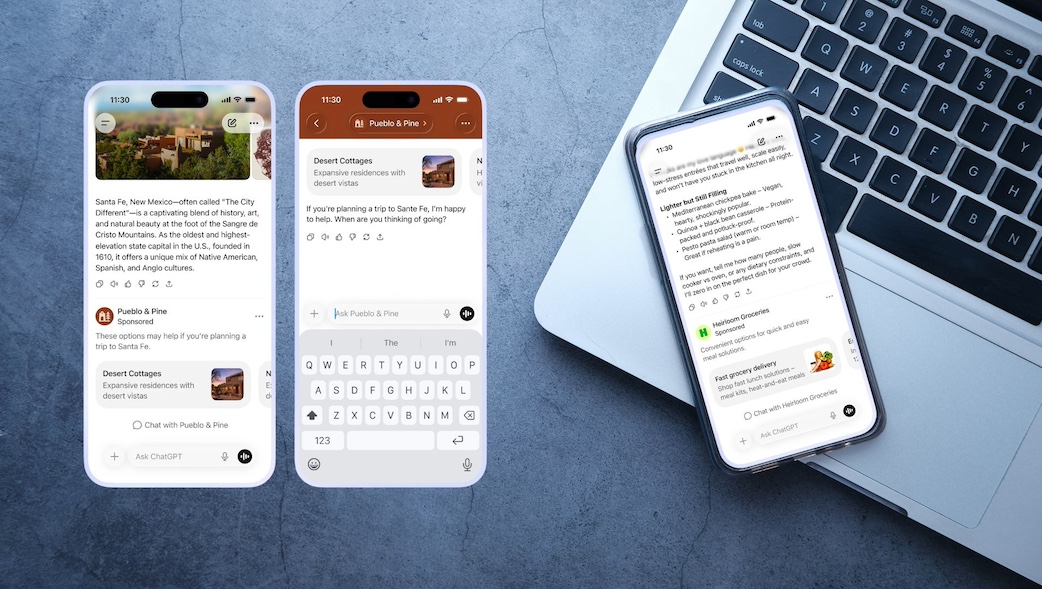

A conversa como canal

A OpenAI lançou anúncios no ChatGPT em fevereiro de 2026. Em noventa dias, ativou CPC, contratou o VP de publicidade da Meta e atraiu a regulação europeia.

Inteligência Artificial

IA sem gestão não entrega: o que três grandes estudos revelam sobre...

O gargalo da Inteligência Artificial nas empresas virou execução, contexto e gestão, com 7,9 horas por semana perdidas em atrito e apenas 12% dos funcionários dizendo que o trabalho de fato mudou

Inteligência Artificial

A economia da IA mudou

Modelos mais baratos não significam menor gasto. Embora o preço por token tenha caído, o volume de uso passou a definir a conta.

Inteligência Artificial

Por que a robótica ainda não escala? Cenários para autonomia físic...

Relatório projeta quatro cenários para o futuro da robótica e aponta desafios de regulação, investimento e adoção em ambientes reais.

Inteligência Artificial

Pricing: onde a IA gera ROI verificável

Enquanto 90% das iniciativas de IA ainda não saíram do piloto, o pricing B2B já tem resultados no P&L

Inteligência Artificial

Mythos, o modelo que encontra falhas que passaram décadas invisíveis

Quando encontrar brechas deixa de ser difícil, todo cuidado é pouco. Por isso, a Anthropic lançou o modelo para apenas 50 empresas parceiras. O Project Glasswing inaugura uma nova fase da cibersegurança.