Matérias relacionadas

Inteligência Artificial

Deepfake-as-a-Service ganha escala

Governos e empresas precisam criar estruturas de confiança digital diante da escalada de fraudes sintéticas, clonagem de identidade e campanhas automatizadas de desinformação.

Inteligência Artificial

O gap que os dashboards não medem

Automação e augmentação produzem ganhos semelhantes nos primeiros trimestres e resultados opostos nos anos seguintes

Inteligência Artificial

A IA acelerou o código e o ataque

A aceleração do código gerado por IA reduziu o custo da automação ofensiva, ampliou vulnerabilidades em software corporativo e expôs limites operacionais dos modelos tradicionais de AppSec.

Inteligência Artificial

“Poderíamos acelerar pelo menos 10 vezes antes de chegar no limite�...

Com 2.000 pessoas em desenvolvimento de produto e a meta de ter 100% do time focado em IA até o fim do ano, ele fala sobre o que ainda não foi desmontado e o que mudou para sempre

Inteligência Artificial

“A estratégia importa, mas a execução vence”: o COO da Zendesk...

Craig Flower, recém-nomeado COO da Zendesk, explica como a empresa saiu de 20% para 65% de auto-resolução no próprio atendimento — e o que isso significa para qualquer empresa que queira usar IA de verdade

Inteligência Artificial

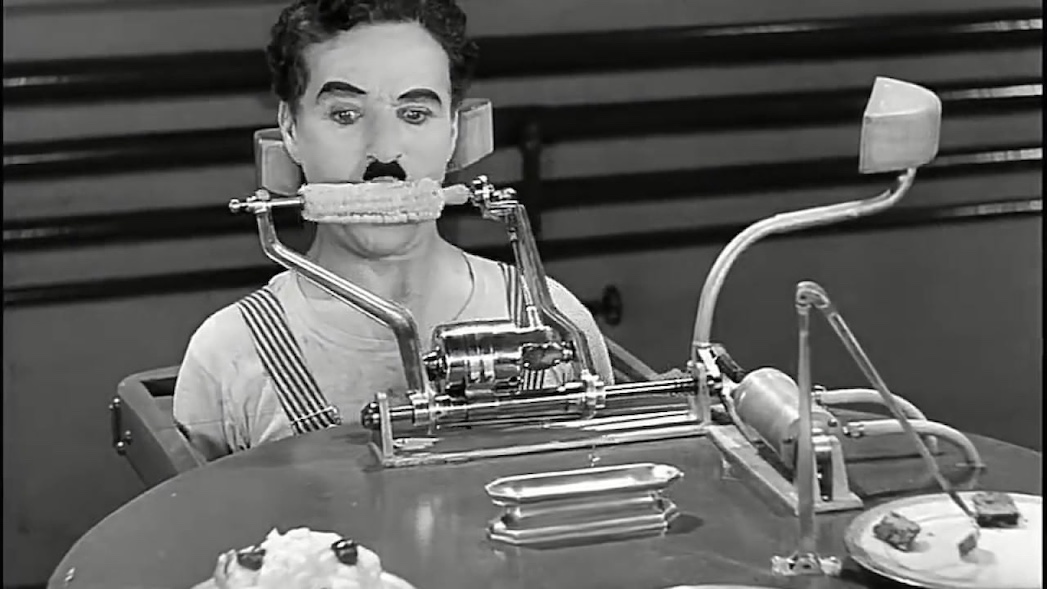

A IA quer um corpo

A indústria aposta que a próxima interface computacional é o espaço físico. Os dados de investimento sustentam a tese. Os casos de uso, ainda não.